Les modèles de traduction statistique proposés par IBM

2.3.3 Les modèles de traduction proposés par IBM

[Brown et al, 1993] propose cinq modèles de traduction 1, 2, 3, 4 et 5. Chaque modèle a sa propre prescription pour calculer la probabilité conditionnelle P(f|e), qu’on appelle la probabilité de traduction.

Toute paire de mots reliés (ei,fj) du corpus d’entraînement est un paramètre du modèle. On fait un choix initial de l’ensemble des paramètres du modèle, puis on applique un algorithme d’estimation afin d’améliorer la vraisemblance du corpus d’entraînement.

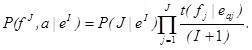

Notation: On cherche à modéliser P(F=fJ|E=eI) où E est l’ensemble de phrases anglaises, F est l’ensemble de phrases françaises. eI=e1,…,eI et fJ=f1,…,fJ sont deux phrases particulières de E et F. A(eI,fJ) est l’ensemble des alignements liant une phrase anglaise donnée à une phrase française. On note par P(F=fJ,A=a|E=eI) la probabilité de jointe de fJ et d’un alignement particulier a.

Alors : ![]() (2.6)

(2.6)

Durant ce travail, nous avons expérimenté les trois premiers modèles de IBM que nous décrivons maintenant brièvement.

2.3.3.1 Modèle de traduction probabiliste IBM1

Pour modéliser P(F=fJ,A=a|E=eI), il y a trois paramètres à estimer:

- Choisir la longueur J (nombre de mots) de la phrase française fJ que l’on cherche à générer (selon le modèle P(J|eI) ). La phrase française est habituellement plus longue que la phrase anglaise.

- Pour chaque mot français, soit fj le mot considéré, choisir une position (entre 0 et J) dans eI associée à fj selon la distribution a. eaj est le mot qui est responsable de la génération du jieme mot de fJ. Dans le modèle 1, tous les alignements sont équiprobables et indépendants de la position du mot dans la phrase française. Chaque mot français fj possède donc I+1 positions possibles (+1 car le mot NULL e0 est considéré).

- Choisir en utilisant les distributions de transfert un mot français fj sachant cette position déterminée.

Donc,  (2.7)

(2.7)

Dans le cas du modèle 1, [Brown et al., 1993] ont démontré que P(fJ|eI) peut-être calculé de manière exacte par la formule suivante: ![]() (2.8)

(2.8)

Où ε désigne la probabilité P(J|eI).

2.3.3.2 Modèle de traduction probabiliste IBM2

Dans IBM1, la probabilité d’alignement d’un mot anglais en position i avec un mot français en position j est indépendante des positions i et j. Toutes les positions sont possibles et équiprobables.

Cependant l’expérience sur un corpus bilingue (français/ anglais telles que les phrases sources et cibles soient de 8 mots) montre que dans 70% de cas (Voir tableau 1), les mots correspondants ont les mêmes positions, dans 10% des cas les mots diffèrent d’une position et dans 5% ils diffèrent de deux positions.

| SourceCible | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 |

| 1 | 0.85 | 0.1 | 0.5 | |||||

| 2 | 0.15 | 0.7 | 0.1 | 0.05 | ||||

| 3 | 0.05 | 0.1 | 07 | 0.1 | 0.05 | |||

| 4 | 0.5 | 0.1 | 0.7 | 0.1 | 0.05 | |||

| 5 | 0.05 | 0.1 | 0.7 | 0.1 | 0.05 | |||

| 6 | 0.05 | 0.1 | 0.7 | 0.1 | 0.05 | |||

| 7 | 0.05 | 01 | 07 | 0.15 | ||||

| 8 | 0.05 | 0.1 | 0.85 |

Tableau 1: Les probabilités des alignements sur un corpus de phrases de 8 mots (anglais /français).

IBM2 remédie à cette simplification à outrance en introduisant des probabilités d’alignement a(i|j,J,I) : la probabilité qu’un mot anglais en position i soit associé à un mot français en position j, sachant les longueurs respectives (I et J comptées en mot) des deux phrases considérées.

On élabore alors la probabilité d’alignement a(aj|j,J,I) comme un nouveau paramètre pour le modèle 2 sous la contrainte stochastique.![]() (2.9)

(2.9)

P(eI|fJ) devient alors dans le cas du modèle 2 : ![]() (2.10)

(2.10)

On remarque que le modèle 1 est un cas particulier du modèle 2 en fixant a(i|j,J,I) à (I+1)-1. Ceci permet à [Brown et al, 1993] de proposer d’entraîner un modèle 1 (dont l’entraînement converge vers un optimum global) pour initialiser l’entraînement d’un modèle 2, pour lequel la convergence n’est que locale.

2.3.3.3 Modèle de traduction probabiliste IBM3

Le modèle 3 introduit la notion de fertilité que nous utilisons indirectement dans nos décodeurs. Nous introduisons donc cette notion et laissons le soin au lecteur de lire [Brown et al, 1993] pour plus de détails.

Le modèle 2 intègre indirectement cette notion de fertilité: Le nombre de mots français connectés à un mot anglais particulier donne un indicateur de sa fertilité.

Cependant, le modèle 3 intègre la fertilité comme un paramètre. Introduisons une nouvelle variable aléatoire appelée fertilité (dénoté ) qui représente la distribution du nombre de mots cible français générés par un mot source anglais particulier.

Par exemple :

(the) est souvent traduit par un mot (le, la, l’), mais peut également ne pas être traduit. (fertilité 1 ou bien 0)

(only) est très souvent traduit par un seul mot (seulement), mais de temps en temps par deux mots (ne . . . que). (fertilité 1 ou peut-être 2)

(update) est presque systématiquement traduit par 3 mots (mise à jour). (fertilité 3)

Dans le modèle 3, un mot anglais peut se connecter à aucun ou plusieurs mots français.

Les principaux paramètres du modèle 3 sont définis par:

- Les probabilités de fertilité :

est la probabilité que le mot ei a une fertilité

est la probabilité que le mot ei a une fertilité  .

. - Les probabilités de transfert : t(fj|ei) est la probabilité que le mot ei génère le mot français fj.

- Les probabilités de distorsion :

est la probabilité que le mot français de la position j soit généré par le mot anglais de la position i (J et I les longueurs de phrases).

est la probabilité que le mot français de la position j soit généré par le mot anglais de la position i (J et I les longueurs de phrases).

À noter que les probabilités de distorsion sont inversées par rapport à celles d’alignement du modèle 2.

[Brown et al., 1993] proposent de convertir les paramètres obtenus à la suite de l’entraînement du modèle 2 pour initialiser les paramètres du modèle 3.

2.4 Conclusion

Dans cette partie, nous avons présenté les différents problèmes de la traduction statistique ainsi que les trois premiers modèles proposés dans [Brown et al, 1993]. Pour la conception d’un décodeur, nous avons utilisé un trigramme développé au RALI et qui a déjà montré ses performances.

D’autre part dans les prochains chapitres, nous mettrons à l’épreuve un outil du package Egypt baptisé Giza qui permet l’entraînement des modèles IBM. Ainsi donc, dans les chapitres trois et quatre, nous mettrons en exergue le fonctionnement et les différents modules du package Egypt. Le problème de décodage fera l’objet du chapitre 5.

Voir [Brown et al, 1993] pour les détails.